Esta historia está sindicada del boletín Big Technology de Substack; suscríbete gratis aquí .

mejores sitios para comprar vaporizadores

Frente a una sala repleta la semana pasada en la Cumbre Mundial de IA de Ámsterdam, le pedí a los investigadores principales de Meta, Google, IBM y la Universidad de Sussex que hablaran si no querían que la IA reflejara la inteligencia humana. Después de unos momentos de silencio, ninguna mano se levantó.

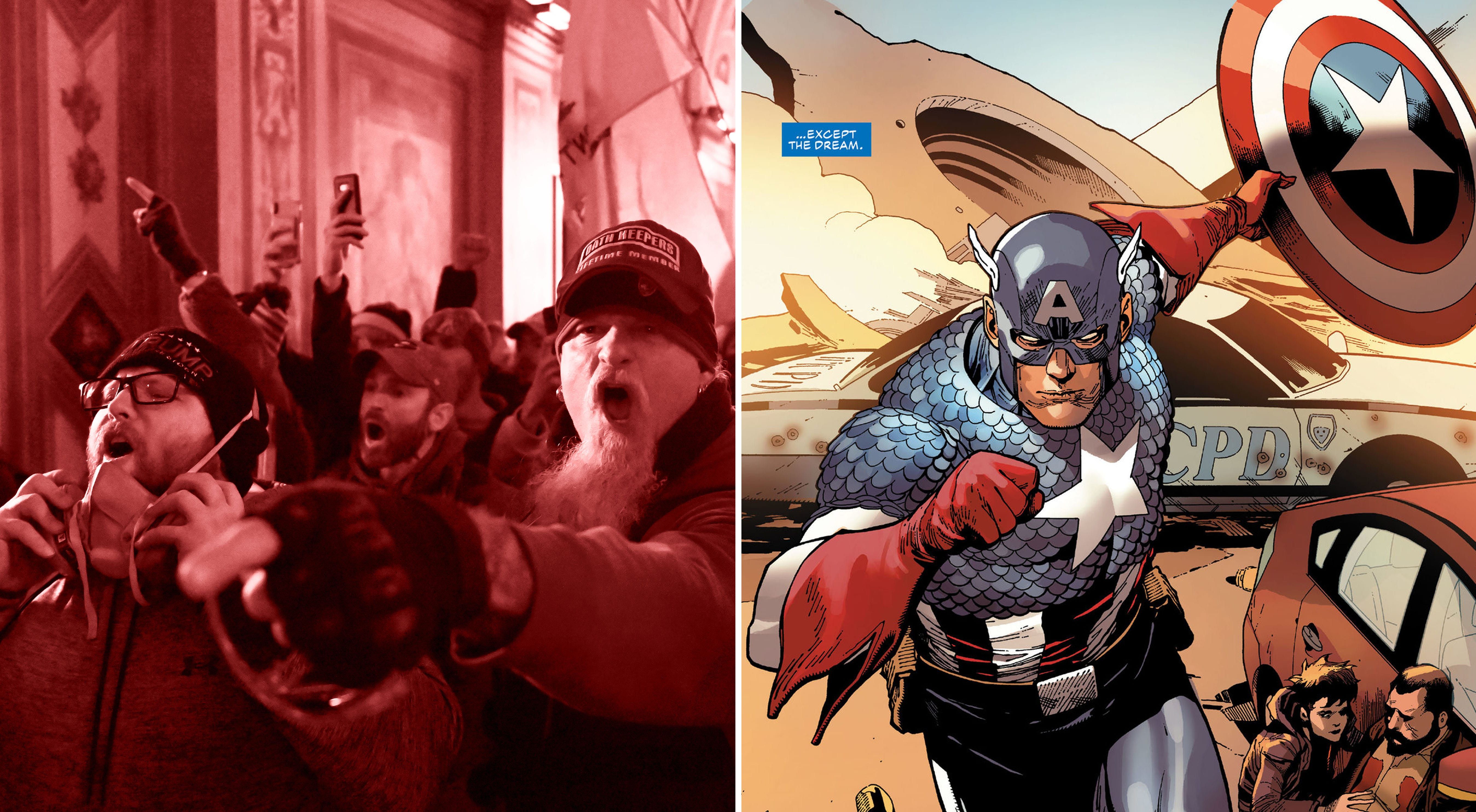

La respuesta reflejó la ambición de la industria de la IA de desarrollar la cognición a nivel humano, incluso si pudiera perder el control de la misma. La IA no es sensible ahora, y no lo será por algún tiempo, si es que alguna vez lo será, pero una industria de IA determinada ya está lanzando programas que pueden chatear, ver y dibujar como humanos mientras intenta llegar allí. Y a medida que avanza, corre el riesgo de que su progreso se deslice hacia lo peligroso desconocido.

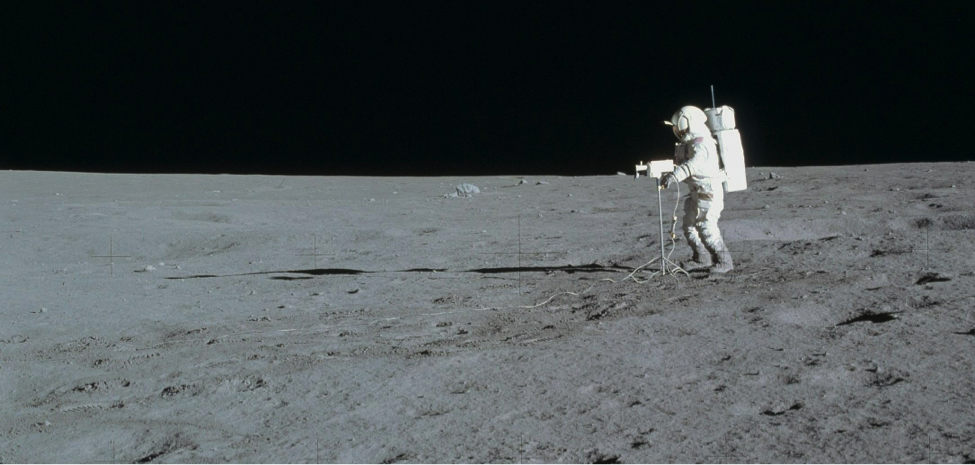

“No creo que se pueda cerrar la caja de Pandora”, dijo Grady Booch, científico jefe de IBM, sobre la eventual IA a nivel humano. “Al igual que las armas nucleares, el gato está fuera de la bolsa”.

Comparar el progreso de la IA con las armas nucleares es adecuado pero incompleto. Los investigadores de IA pueden emular el deseo de los científicos nucleares de lograr el progreso técnico a pesar de las consecuencias, incluso si el peligro está en diferentes niveles. Sin embargo, más personas accederán a la tecnología de inteligencia artificial que los pocos gobiernos que poseen armas nucleares, por lo que hay pocas posibilidades de una restricción similar. La industria ya está mostrando una incapacidad para mantenerse al día con sus frenesí de avances .

La dificultad de contener la IA se hizo evidente a principios de este año después de que OpenAI presentara Dall-E, su programa de arte de IA. Desde el principio, OpenAI ejecutó Dall-E con reglas bien pensadas para mitigar sus inconvenientes y una implementación lenta para evaluar su impacto. Pero a medida que Dall-E tomó impulso, incluso OpenAI admitió que poco podía hacer con los imitadores. “Solo puedo hablar con OpenAI” dijo Cuando se le preguntó al investigador de OpenAI, Lama Ahmad, sobre posibles emuladores.

Los imitadores de Dall-E llegaron poco después y con menos restricciones. Competidores como Stable Diffusion y Midjourney democratizaron una tecnología poderosa sin barreras, y todo el mundo comenzó a hacer imágenes de IA. Dall-E, que solo incorporó 1000 nuevos usuarios por semana hasta fines del mes pasado, luego abierto a todos .

tema más googleado en 2018

Es probable que surjan patrones similares a medida que se abre paso más tecnología de inteligencia artificial, independientemente de las medidas de seguridad que empleen los desarrolladores originales.

Es cierto que es un momento extraño para discutir si la IA puede reflejar la inteligencia humana, y qué cosas extrañas sucederán en el camino, porque gran parte de lo que la IA hace hoy es elemental. Las deficiencias y los desafíos de los sistemas actuales son fáciles de señalar, y muchos en el campo prefieren no involucrarse en preguntas a más largo plazo (como si la IA puede volverse sensible) ya que creen que es mejor gastar su energía en problemas inmediatos. Los a corto plazo y los a largo plazo son dos facciones separadas en el mundo de la IA.

Sin embargo, como hemos visto este año, la IA avanza a toda prisa. Avances en grandes modelos de lenguaje hizo que los chatbots fueran más inteligentes, y ahora estamos discutiendo su sensibilidad (o, más exactamente, la falta de ella). El arte de la IA no estaba en la imaginación del público el año pasado, y ahora está en todas partes. AI también es ahora creando videos de cadenas de texto. Incluso si eres a corto plazo, el largo plazo puede llegar antes de lo previsto. Me sorprendió la cantidad de científicos de IA que dijeron en voz alta que no podían, y no querían, definir la conciencia.

Hay una opción, por supuesto, de no ser como los científicos de armas nucleares. Pensar de manera diferente a como lo expresó J. Robert Oppenheimer, quien dirigió el trabajo sobre la bomba atómica. “Cuando ves algo que es técnicamente bueno”, dijo, “sigues adelante y lo haces y discutes sobre qué hacer al respecto solo después de haber tenido tu éxito técnico”.

espero que mi correo te encuentre bien

Tal vez pensar más esta vez conduciría a un mejor resultado.